社内での生成AI利用における著作権侵害、機密情報漏洩、バイアス(偏見)といった法的・倫理的リスクを管理するための指針を策定し、運用を徹底する施策です。2026年は、ガイドラインを定めるだけでなく、AIが作成した成果物を自動チェックし、リスクが高い場合に警告を出す「AI監査ツール」の導入までをセットで行います。メリットは、社員が安心してAIを使いこなし、法的トラブルを恐れずに業務効率を最大化できる環境を整えられる点です。法務は最新の国際的なAI規制を反映したルールを設計し、社内SEはAI利用ログの監視基盤を構築。守りと攻めのバランスを最適化し、企業のデジタル信頼性(デジタル・トラスト)を世界水準で担保します。

職種 職種 |

総務・法務 |  施策難易度 施策難易度 |

★★★☆☆ |

|---|---|---|---|

業界① 業界① |

全業界 |  目的 目的 |

リスク低減 信頼構築 |

業界② 業界② |

対象 対象 |

AIリスク管理 | |

費用 費用 |

10〜300万円 | 60 |

主なToDo

- 最新のAI関連法規・判例に基づくガイドラインの起案

- AI利用ログの自動モニタリングツールの導入検討

- 「AI倫理委員会」の設置と定期的なリスクアセスメント

期待できる効果

法的トラブルの未然防止。顧客・投資家からの信頼獲得。

躓くところ

技術進化の速さへの追随。現場の利便性と制限のバランス。

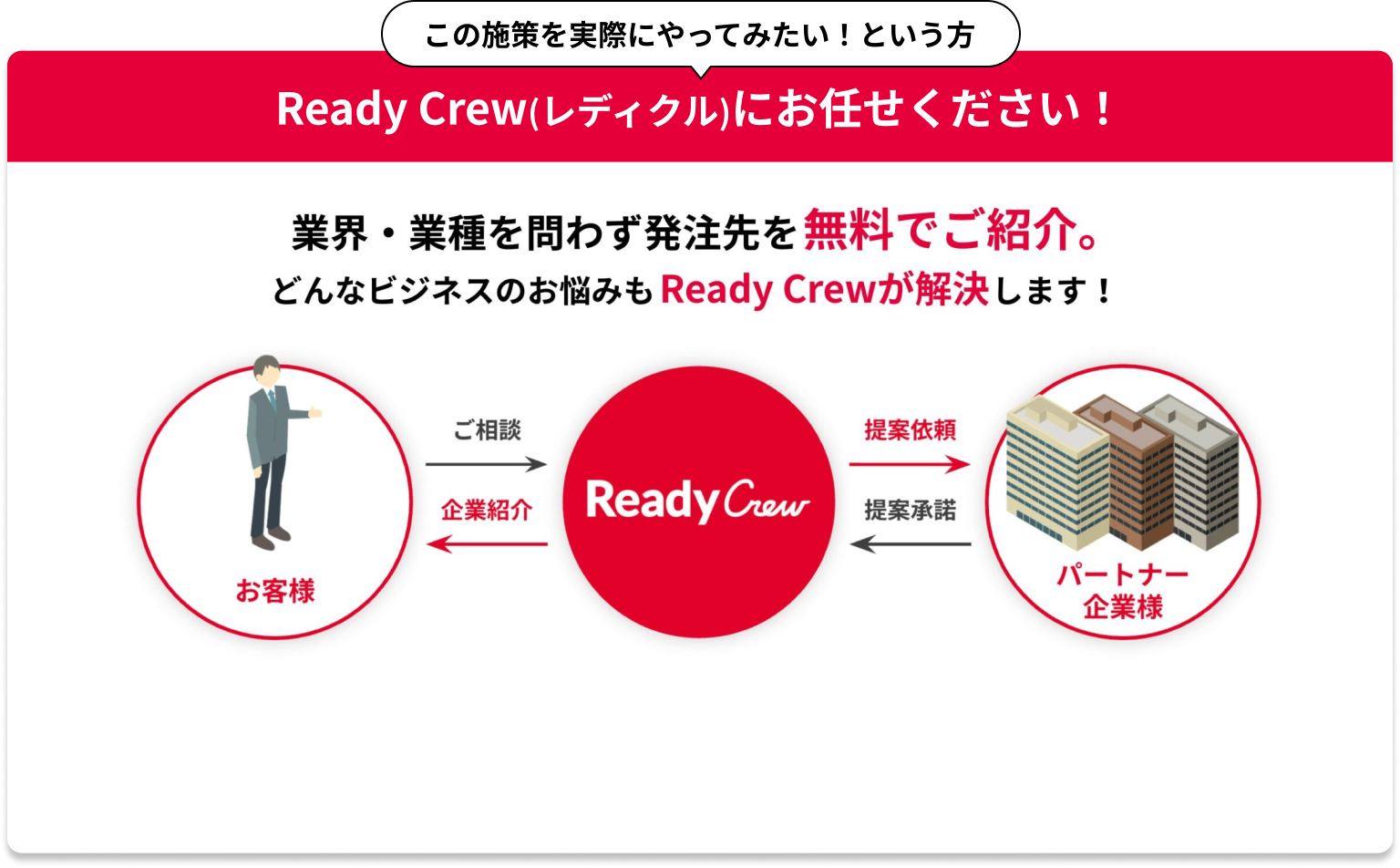

「AIガバナンス」ガイドライン策定・運用支援

「AIガバナンス」ガイドライン策定・運用支援